Le débat relatif à la propriété intellectuelle s'applique à la fois aux humains et aux modèles génératifs. Ou plutôt, elles s'appliquent aux entreprises qui « créent » de tels modèles. À cet égard, il existe une innovation significative dans le monde de la génération d’images numériques : l'introduction de filigranes spécifiques pour les images créées via DALL-E3. Cela promet de rendre le frontière entre le contenu généré artificiellement et le contenu humain non seulement plus défini mais aussi plus transparent.

Comment reconnaître les images créées par des modèles génératifs ? Avec le filigrane sur DALLE-E 3, pour commencer

OpenAI a récemment introduit une fonctionnalité qui pourrait changer la façon dont nous percevons le contenu numérique : un système de filigrane pour les images générées par DALL-E 3. Cette mise à jour vise à établir un pont entre la production croissante de contenu numérique et le besoin d'une plus grande transparence et fiabilité.

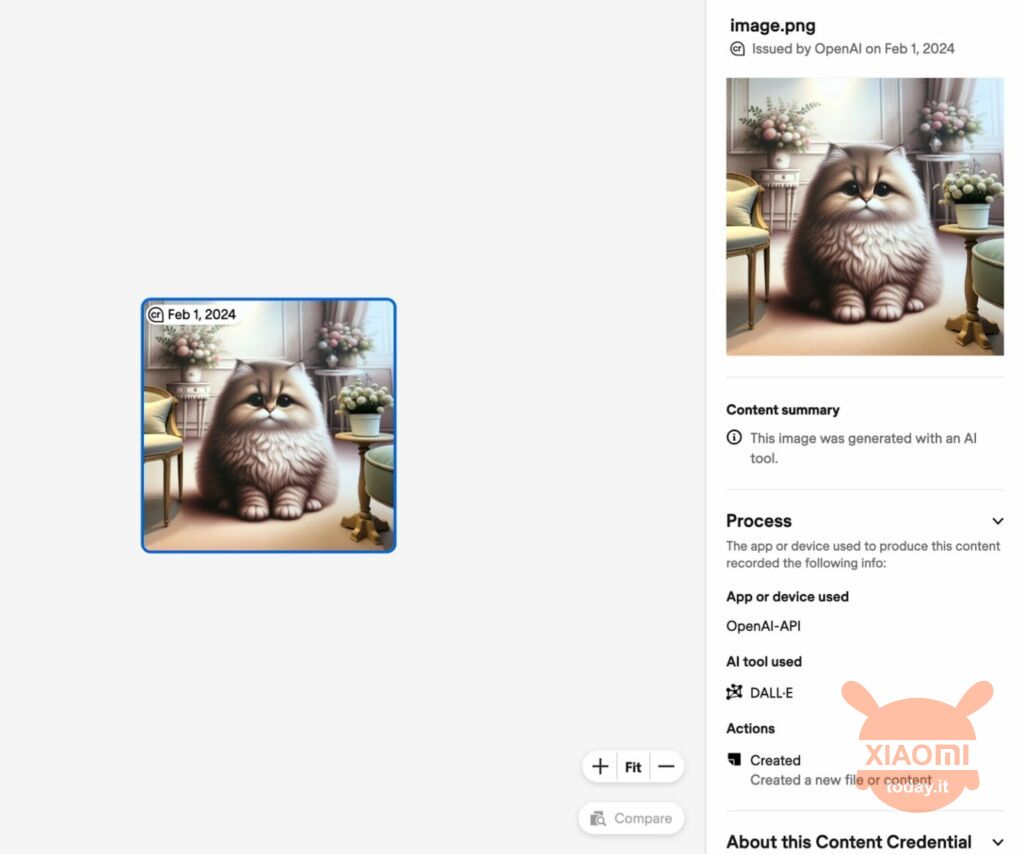

Le système de filigrane implémenté sur DALL-E 3 est divisé en deux composants: une partie invisible intégrée aux métadonnées de l'image et un symbole visible, représenté par le logo CR, discrètement positionné dans le coin supérieur gauche de l'image. L'objectif est double : d'une part, faciliter l’identification des origines d’une image numérique, permettant aux utilisateurs de vérifier s'il a été généré grâce à l'intelligence artificielle ; de l'autre, garder la qualité visuelle de l'image inchangée, malgré l'ajout de nouveaux éléments.

Lire aussi: DALL-E 3 est officiel : maintenant pour tout le monde sur ChatGPT

Cette évolution s’inscrit dans un contexte plus large, soutenu par Coalition pour la provenance et l'authenticité du contenu, un consortium impliquant des géants de la technologie tels qu'Adobe et Microsoft. Ceux-ci s'engagent à promouvoir l’authenticité du contenu numérique via le filigrane Content Credentials, contribuant ainsi à établir une distinction claire entre le travail créatif humain et celui généré par l’IA.

Malgré l'enthousiasme suscité par cette innovation, des défis importants demeurent, principalement liés à possibilité que les métadonnées puissent être supprimées, volontairement ou non, lors du partage sur les réseaux sociaux ou d'autres plateformes numériques. Cette vulnérabilité met en évidence la complexité de la lutte contre la désinformation et la nécessité de stratégies efficaces pour vérifier le contenu numérique.